用於二進制神經擬態計算的 MTJ。信用: 通訊工程 (2025)。 DOI:10.1038/s44172-025-00479-2

如果不依賴必須經過極其昂貴的訓練的人工智能(AI)系統,計算機能否比人類學到更多的東西?

神經形態計算可能就是答案。這項新技術涉及基於大腦的計算機硬件,與傳統系統相比,它可以通過更少的訓練計算更有效地執行人工智能任務,並且使用的功率也少得多。因此,神經形態計算機還可以減少對耗電數據中心的依賴,並將人工智能推理和訓練帶入移動設備。

德克薩斯大學達拉斯分校電氣和計算機工程助理教授 Joseph S. Friedman 博士和他在 NeuroSpinCompute 實驗室的研究團隊在創建神經形態計算機方面邁出了重要一步,他們創建了一個小型原型,該原型可以學習模式並使用比傳統人工智能係統更少的訓練計算進行預測。他們的下一個挑戰是擴大概念驗證規模。

弗里德曼說:“我們的工作展示了一種潛在的新方法,可以創建能夠自主學習的受大腦啟發的計算機。” “由於神經形態計算機不需要大量的訓練計算,因此它們可以為智能設備提供動力,而無需消耗大量能源。”

該團隊包括來自 Everspin Technologies Inc. 和德州儀器 (TI) 的研究人員,在一項研究中描述了該原型。 發表 V 通訊工程。

傳統計算機和 GPU 將內存與信息處理分開。因此,他們無法像人腦一樣有效地得出人工智能結論。它們還需要大量的標記數據和大量複雜的訓練計算。這些訓練計算的成本可能高達數億美元。

神經形態計算機將內存存儲與處理結合起來,使它們能夠以更高的效率和更低的成本執行人工智能操作。神經形態硬件的靈感來自大腦,其中神經元和突觸網絡分別處理和存儲信息。突觸在神經元之間形成連接,根據活動的性質加強或減弱。這使得大腦在學習時不斷適應。

弗里德曼的方法基於神經心理學家唐納德·赫布博士提出的一個原理,即赫布定律:一起放電的神經元連接在一起。

弗里德曼說:“我們用來單獨訓練計算機的原理是,如果一個人工神經元激發另一個人工神經元,連接它們的突觸就會變得更加導電。”

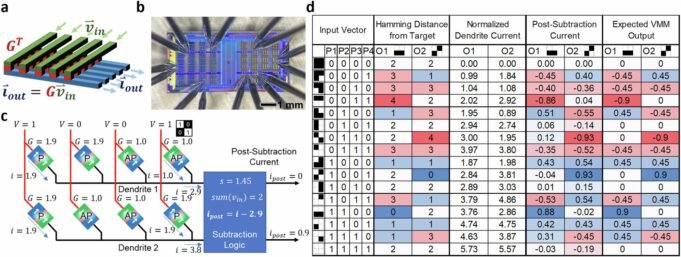

Friedman 設計的主要創新是磁隧道結 (MTJ) 的使用,這是一種納米級器件,由兩層磁性材料組成,並由絕緣層隔開。當各層的磁化強度沿一個方向排列時,電子可以更容易地移動或隧道穿過該勢壘,而當它們沿相反方向排列時,則不太容易移動或隧道穿過該勢壘。

在神經形態系統中,MTJ 可以聯網來模仿大腦如何處理和學習模式。當信號以協調的方式通過 MTJ 時,它們的連接會適應,從而加強某些通路,類似於學習過程中大腦中突觸連接的加強方式。 MTJ 的二進制切換使它們能夠強大地存儲信息,解決了長期以來阻礙替代神經擬態方法的問題。

附加信息:

Peng Zhou 等人,通過磁隧道結突觸進行神經形態赫布學習, 通訊工程 (2025)。 DOI:10.1038/s44172-025-00479-2

引文:神經形態計算機原型以比傳統 AI 更少的計算量學習模式(2025 年 10 月 29 日),2025 年 10 月 29 日檢索自 https://techxplore.com/news/2025-10-neuromorphic-prototype-patterns-traditional-ai.html。

本文檔受版權保護。除善意用於私人學習或研究目的外,未經書面許可不得複制任何部分。所提供的內容僅供參考。