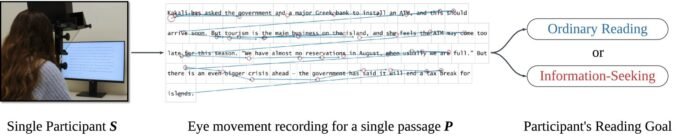

提出的任務:鑑於他們的眼睛運動超過一個邊距,解碼讀者是尋找特定信息還是閱讀以進行一般理解。在眼睛運動的圖像中,圓圈代表固定,線條代表Sakkada。限制框注意單詞感興趣的區域(現場的固定與相應的單詞相關)。信用: arxiv (2024)。 doi:10.48550/arxiv.2410.20779

來自數據和科學技術學院的研究人員已經開發了一種技術,該技術可以決定讀者與文本相互作用的各個方面,僅基於其眼動。

團隊的結論是 提出 v 計算語言學協會維也納自然語言處理(NLP)的會議。這項研究是由醫生的學生Omer Shubi與學生Kfir Hadar大師一起在Evgeny Berzak博士的領導下進行的。

人們閱讀具有不同目標的文本。無論是小說,烹飪的食譜,報紙文章還是科學文章,每種類型的文本都可以適合各種意圖。閱讀的兩個共同目標是一般理解(常規閱讀)和信息搜索。

研究人員開發了將眼動跟踪與文本處理相結合的計算模型。這些模型可以準確地檢測到讀者的目標,其準確性約為90%,而從閱讀開始的那一刻起,幾乎80%的精度僅為兩秒鐘。

根據Berzak博士的說法,“這項研究是一個更廣泛的研究計劃的一部分,我們在該計劃中開發了AI的模型,AI的模型僅來自眼動,僅從眼動,讀者的語言知識的關鍵方面,與文本的互動,第一和二讀之間的差異,對本文的可讀性,甚至是讀者尋找的特定信息之間的差異。

“這些研究為評估語言知識的新方法鋪平了道路,根據讀者的語言和閱讀,對文本的個性化,改善了各種人群群體的文本信息的可用性等等。”

眼睛跟踪技術變得越來越普遍,負擔得起和準確,現在有些在iPad和智能手機等通用設備上可用。研究人員希望這些事件能夠加快其模型,從而使教育,政府和媒體等領域的用戶和內容供應商受益。

伊夫根尼亞·伯扎克(Evgenia Berzak)博士是決策數據和科學學院的老師,計算機和知識實驗室負責人,在哲學博士完成後,於2021年加入了這項技術。和馬薩諸塞州技術研究所的郵政。

更多信息:

Omer Shubi等人,解碼從眼動的閱讀目標, 第63屆計算語言學協會年度收集的材料(第1卷:長娃娃) (2025)。 doi:10.18653/v1/2025.acl-long.280

引用:如果發現讀者(2025年8月11日),技術趨勢技術達到了90%的準確性(2025年8月11日),並於2025年8月11日從https://techxplore.com/news/news/2025-08-iye-iye-iye-tracking-tracking-tech-curacy-regacy-regency-regency-regmml收到

該文檔具有版權。除了出於私人研究或研究目的的一些公平交易外,如果沒有書面解決方案,就無法再現。內容僅用於信息目的。